Herzlich Willkommen beim beam-Verlag in Marburg, dem Fachverlag für anspruchsvolle Elektronik-Literatur.

Wir freuen uns, Sie auf unserem ePaper-Kiosk begrüßen zu können.

1-2-2019

- Text

- Software

- Elektromechanik

- Positioniersysteme

- Antriebe

- Stromversorgung

- Feldbusse

- Kommunikation

- Robotik

- Qualitaetssicherung

- Bildverarbeitung

- Automatisierungstechnik

- Sensorik

- Messtechnik

- Visualisieren

- Regeln

- Msr

- Boards

- Systeme

- Sbc

- Ipc

Fachzeitschrift für Industrielle Automation, Mess-, Steuer- und Regeltechnik

Bildverarbeitung Bild 3:

Bildverarbeitung Bild 3: “An analysis of Deep Neural Network Models for Practical Applications” von Alfredo Canziani, Adam Paszke, Eugenio Culurciello (2017) Industrie 4.0 sowie Drohnen und autonomes Fahren deutlich. Die höhere Rechengenauigkeit von GPUs und damit auch höhere Vorhersagegenauigkeit wird durch deutlich kürzere Verfügbarkeiten, höhere Leistungsaufnahme, aber auch durch einen geringeren Datendurchsatz erkauft. Ein exemplarischer Vergleich der Leistung der Datenbearbeitung liegt bei einer FPGAbasierten Lösung um Faktor 7,3 höher als bei einer vergleichbaren Systemlösung mit GPUs (Bild 4). FPGA-Ressourcen optimieren Für Deep Learning gibt es unterschiedliche Methoden, Ressourcen einzusparen ohne die Qualität der Klassifizierung zu beeinträchtigen. Eine wichtige Methode ist die Skalierung der Bilder, die den internen Datendurchfluss reduziert. Oder die Rechentiefe: Erfahrungswerte haben gezeigt, dass die Rechentiefe sich nur marginal auf die spätere Vorhersagegenauigkeit durchschlägt. Die Reduktion von 32 bit auf 8 bit und von Floating Point auf Fixed Point / Integer ermöglicht dem FPGA, die gestiegenen Ressourcen für größere Netzarchitekturen oder einen höheren Datendurchsatz zu nutzen. Dadurch ist es möglich, die Produktionsgeschwindigkeit etwa bei der Schweißnaht-Inspektion oder Robotik zu steigern. Eine datenreduzierende Bildvorverarbeitung ermöglicht es darüber hinaus, kleinere Netze oder FPGAs einzusetzen. Diese reichen oftmals für Klassifizierungsaufgaben mit wenigen Merkmalen für die Fehlerdetektion aus. Die höhere Rechengenauigkeit einer 32 bit Floating Point GPU ist für die Deep Learning-Inference von geringer Bedeutung, erreichen doch 8 bit Fixed Point FPGAs eine ausreichend präzise Vorhersagegenauigkeit für die meisten Deep Learning-Anwendungen bei zu vernachlässigender Fehlertoleranz. Bei Anforderungen nach besonders präziser Rechengenauigkeit lässt sich auf einem größeren FPGA als Ressourcenkompromiss auch 16 bit Fixed Point implementieren. Für die in der Produktion erforderlichen Verarbeitungsgeschwindigkeiten existieren bereits Lösungen mit Hochleistungs-Framegrabbern oder eingebetteten Vision-Geräten wie Kameras und Sensoren mit größeren FPGAs. Mit umfangreicheren FPGA-Ressourcen lassen sich komplexere Architekturen und damit auch Anwendungen verarbeiten. Die höhere Datenbandbreite ermöglicht eine Verarbeitung eines Gesamtbildes oder zusätzliche Bildvor- und -nachverarbeitung auf dem FPGA. Sie ist ausreichend hoch, um beispielsweise den kompletten Datenausgang einer GigE Vision Kamera über Deep Learning zu analysieren. Fazit Im Vergleich zur klassischen Bildverarbeitung wird ein relativ hoher Trainingsaufwand bei Deep Learning durch Zuverlässigkeit und Schnellig keit mehr als aufgewogen. Die FPGA-Technologie auf Framegrabbern und (eingebetteten) Vision-Geräten ermöglicht den Einsatz von neuronalen Netzen für Anwendungen mit industriellen Anforderungen an Echtzeitfähigkeit bzw. geringen Latenzen (wichtig für Inline-Inspektion), Datendurchsatz, Bandbreite und geringe Wärmeleistung (wichtig für embedded Vision), auch für hoch aufgelöste Bilder. Die lange Verfügbarkeit von FPGAs und Framegrabbern gewährleistet eine hohe Investitionssicherheit. Anwender profitieren von langfristigen Einsparungen durch schnelle Anpassbarkeit und geringere Gesamt systemkosten. ◄ Bild 4: Die FPGA-Leistung ist 7,3-mal höher als diejenige der GPU [Quelle: Silicon Software GmbH] 64 PC & Industrie 1-2/2019

Bildverarbeitung ALPR/ANPR-Software-Suite mit Deep Learning Die Carrida-Software-Engine für die automatische Nummernschilderkennung (ALPR/ANPR) wurde jetzt um die neue Funktion Fahrzeugtypenerkennung erweitert, die mit Deep-Learning-Algorithmen umgesetzt wird. Aktuell erkennt Carrida Make & Model Hunderte europäische und US-amerikanische Fabrikate und Typen. Das Tool kann alleinstehend verwendet werden oder zusammen mit der Nummernschilderkennung, um die Erkennungsgenauigkeit zu erhöhen. Vision Components hat seit 2014 ein leistungsstarkes, praxiserprobtes Lösungsangebot für OEMs im Bereich Zufahrtskontrolle, Straßenverkehrsüberwachung und Smart City auf die Beine gestellt. Dieses wird seit Kurzem federführend von der Tochterfirma Carrida Technologies GmbH vermarktet und weiterentwickelt. • Vision Components GmbH www.vision-components.com www.carrida-technologies.com Langlebiges Zoomobjektiv für automatisierte Inspektion Qioptiq, ein Unternehmen von Excelitas Technologies, liefert ab sofort die zweite Generation des Zoomobjektivs Fetura+, die sich durch höchste optomechanische Präzision auszeichnet. Das Objektiv deckt einen Zoombereich von 1:12,5 ab und ist objekt- und bildseitig nach unendlich korrigiert. Dadurch ist es voll kompatibel mit der modularen Mikroskopie- Plattform Optem Fusion. Diese ermöglicht die schnelle, flexible und kostengünstige Einrichtung von Objektivsystemen für labor technische und industrielle Anwendungen. Qioptiq hat die optische Leistung bei den Zoomobjektiven der neuen Generation noch weiter verbessert. Die neuen Modelle bieten insbesondere in den Ecken des Bildfeldes einen höheren Kontrast. Vergrößerungen und Zoomgeschwindigkeiten können frei programmiert und automatisch gesteuert werden. Eine neue Firmware ermöglicht kontinuierliches optisches Zoomen bei konstanter Fokuslage – in Videoaufnahmen bleibt das Bild also auch beim Zoomvorgang immer scharf. Durch Optimierungen an der Mechanik und der integrierten Elektronik bleiben die hohe Stabilität und Wiederholgenauigkeit der Fokuslage über eine extrem lange Lebensdauer von über 1 Million Zyklen erhalten. Dies sorgt für höchste Zuverlässigkeit und erhöhte Verfügbarkeit anspruchsvoller industrieller Applikationen. Beispielanwendungen sind die berührungslose Dimensionsmessungen. • Excelitas Technologies Corp. www.excelitas.com Neue Embedded-Kameras mit Sony-Pregius- Bildsensoren Vision Components erreicht mit leistungsstarken CMOS- Sensoren in seinen Embedded- Vision-Systemen herausragende Bildraten. Der Hersteller integriert nun einen weiteren Sony-Pregius- Bildsensor in seine VC-Z-Kameras. Der Sony Pregius IMX392 hat eine Auflösung von 1920 px x 1200 px bei einer Größe von 1/2,3“. Bei Vollauflösung erreicht Vision Components damit eine Aufnahmefrequenz von bis zu 118 fps. Der neue Bildsensor ist in OEM-Platinenkameras mit integriertem Sensor sowie mit einem oder zwei abgesetzten Sensorköpfen mit Flexprint- Kabel erhältlich. Außerdem gibt es zwei Gehäusekameras, die kompakte VCnanoZ und die besonders robuste VCproZ mit Schutzart IP67. Für alle Varianten stehen zahlreiche Schnittstellen zur Verfügung. Der 2,3-Megapixel-Sensor ist bereits der dritte Sony-Pregius- Sensor, den Vision Components integriert. Die genannten Kameramodelle sind wahlweise auch mit dem IMX273 mit 1,6 MP Auflösung und maximaler Bildrate von 170 fps sowie mit dem IMX252 (3,2 MP, 88 fps) verfügbar. Eine noch schnellere Bildverarbeitung ist jeweils bei geringeren Auflösungen möglich. Damit haben OEMs eine praxisgerechte Auswahl an schnellen intelligenten Kameras. • Vision Components GmbH www.vision-components.com Kamera-Ringbeleuchtung jetzt in sechs Farben Für seine Kameraschutzgehäuse der Orca-Baureihe bietet autoVimation die Meganova-Ringbeleuchtung jetzt in sechs Farben mit integriertem Blitzcontroller an. Die montagefreundlichen Einsätze leuchten das Blickfeld der Kamera mit acht Hochleistungs-LEDs in vier optionalen Abstrahlwinkeln zwischen 14° und 76° aus. Als Farben stehen neben zwei Weißtönen auch Rot, Grün, Blau und Infrarot zur Wahl. Um eine Rückspiegelung der Beleuchtung in die Kameraoptik zu unterbinden, wird das Modul mittels der großflächigen Klemmbefestigung direkt hinter der Frontscheibe montiert. Der große offene Innenradius erlaubt auch die Installation von Weitwinkel-Objektiven bis 36 mm Durchmesser unmittelbar an der Gehäusefront. Im Überstrombetrieb lässt sich die Beleuchtungsstärke auf das Vierfache der Nennstrom-Helligkeit steigern, wobei die maximale Belichtungszeit und Bildfrequenz zum Schutz der Leuchten in Abhängigkeit der Stromverstärkung begrenzt wird. Aufgrund der guten Wärmeableitung über das Kameragehäuse ist bei Raumtemperatur auch im Dauerbetrieb eine auf 200 % erhöhte Nennstrom- Helligkeit bei 16 W Leistungsaufnahme möglich. Vor Überhitzung schützt eine permanente Temperaturüberwachung mit automatischer Notabschaltung. • autoVimation GmbH sales@autovimation.com www.autovimation.com PC & Industrie 1-2/2019 65

- Seite 1 und 2:

Januar-Februar 1-2/2019 Jg. 23 Rela

- Seite 3 und 4:

Editorial Der Embedded-PC • aka.

- Seite 5 und 6:

Inhalt 1-2/2019 Flexibel bis ins De

- Seite 7 und 8:

Aktuelles Mehr erfahren im trendige

- Seite 9 und 10:

Sicherheit IT-Security: Wussten Sie

- Seite 11 und 12:

Funkenstrecken im Ex-Bereich - Inst

- Seite 13 und 14: Predictive Maintenance Besonders an

- Seite 15 und 16: Predictive Maintenance benötigt Vo

- Seite 17 und 18: Predictive Maintenance Ablauf der D

- Seite 19 und 20: IoT einen neuen Standort des Device

- Seite 21 und 22: IoT Implementierung von Edge-IoT-Te

- Seite 23 und 24: Bild 3:Vernetzung von Produktion un

- Seite 25 und 26: Software/Tools/Kits Echtzeit-Datens

- Seite 27 und 28: Elektromechanik Filterlüfter biete

- Seite 29 und 30: Elektromechanik Bild 2: Gegenkontak

- Seite 31 und 32: Elektromechanik 4. Kabelanbindung F

- Seite 33 und 34: Elektromechanik Vierkantflansch-Ste

- Seite 35 und 36: Elektromechanik Federkontakte mit S

- Seite 37 und 38: Elektromechanik Standard für Signa

- Seite 39 und 40: Stromversorgung effiziente und beso

- Seite 41 und 42: Stromversorgung Sensor-USV schützt

- Seite 43 und 44: Wide Range 60 W DC/DC-Wandler Strom

- Seite 45 und 46: Bauelemente Neue geschirmte Indukti

- Seite 47 und 48: Antriebe/Positioniersysteme Schnell

- Seite 49 und 50: Robotik Roboter greifen beliebige O

- Seite 51 und 52: PROFINET und OPC UA in der praktisc

- Seite 53 und 54: Kommunikation Datenverarbeitung am

- Seite 55 und 56: Kommunikation Mobiles Funkmodem fü

- Seite 57 und 58: Smarte IoT-Gateway-Intelligenz Komm

- Seite 59 und 60: your IOT Upgrade Industrie-Router b

- Seite 61 und 62: Bildverarbeitung Maschinen lernen d

- Seite 63: Bildverarbeitung Bild 2: Zunahme de

- Seite 67 und 68: Bedienen und Visualisieren IoT-fäh

- Seite 69 und 70: Bedienen und Visualisieren Kleinste

- Seite 71 und 72: Messtechnik Der erweiterte Kabeltes

- Seite 73 und 74: Messtechnik Schneller Produktionste

- Seite 75 und 76: Messung der (Rauch-) Gastemperatur

- Seite 77 und 78: Qualitätssicherung Schnelles und p

- Seite 79 und 80: Sensoren Acht Dinge, die Sie über

- Seite 81 und 82: Sensoren Induktive Wegaufnehmer bis

- Seite 83 und 84: SBC/Boards/Module Leistungsstarke B

- Seite 85 und 86: SBC/Boards/Module Kompaktes Design

- Seite 87 und 88: SBC/Boards/Module System on Module

- Seite 89 und 90: Konduktiv gekühlter GPGPU-Computer

- Seite 91 und 92: Produktindex A Ausführung, 19-Zoll

- Seite 93 und 94: Richard Wöhr GmbH . . . . . . . .

- Seite 95 und 96: IEP GmbH . . . . . . . . . . . . .

- Seite 97 und 98: KEB Automation KG. . . . . . . . .

- Seite 99 und 100: INFRANOR GmbH. . . . . . . . . . .

- Seite 101 und 102: KUNBUS GmbH. . . . . . . . . . . .

- Seite 103 und 104: M3H2 GmbH . . . . . . . . . . . . .

- Seite 105 und 106: HEITEC AG . . . . . . . . . . . . .

- Seite 107 und 108: COMP-MALL GmbH . . . . . . . . . .

- Seite 109 und 110: Moxa Europe GmbH . . . . . . . . .

- Seite 111 und 112: Spectra GmbH & Co. KG . . . . . . .

- Seite 113 und 114: ICO Innovative Computer GmbH . . .

- Seite 115 und 116:

E.E.P.D. GmbH . . . . . . . . . . .

- Seite 117 und 118:

Canvys . . . . . . . . . . . . . .

- Seite 119 und 120:

DATA MODUL AG . . . . . . . . . . .

- Seite 121 und 122:

Wer vertritt wen? A AAEON, TW Bress

- Seite 123 und 124:

A Aaronn Electronic GmbH Zeppelinst

- Seite 125 und 126:

Verkaufsbüros nach PLZ: 22457, Bü

- Seite 127 und 128:

58642, NUM GmbH Büro Nord Tel.: 02

- Seite 129 und 130:

IPCs/Embedded Systeme Kit-Solution

- Seite 131 und 132:

Kontron stellt den FlatClient HYG v

- Seite 133 und 134:

Ihr Partner für zuverlässige Indu

- Seite 135 und 136:

Kompakt, lüfterlos und erweiterbar

- Seite 137 und 138:

IPCs/Embedded Systeme rie, die DC-S

- Seite 139 und 140:

Einbau-Panel-PC jetzt mit integrier

- Seite 141 und 142:

IPCs/Embedded Systeme Robuster kond

- Seite 143 und 144:

IPCs/Embedded Systeme Außergewöhn

- Seite 145 und 146:

IPCs/Embedded Systeme ras, Mikropho

- Seite 147 und 148:

IPCs/Embedded Systeme Bild 2: Typ 7

- Seite 149 und 150:

SENSOR+TEST 2019: Prozessautomation

- Seite 151 und 152:

Aktuelles Live-Demos sowie eine Job

- Seite 153 und 154:

Aktuelles Premiere: start-up Area a

- Seite 155 und 156:

Systeme führender Hersteller für

Unangemessen

Laden...

Magazin per E-Mail verschicken

Laden...

Einbetten

Laden...

hf-praxis

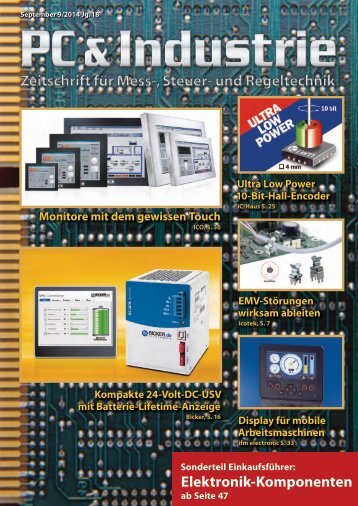

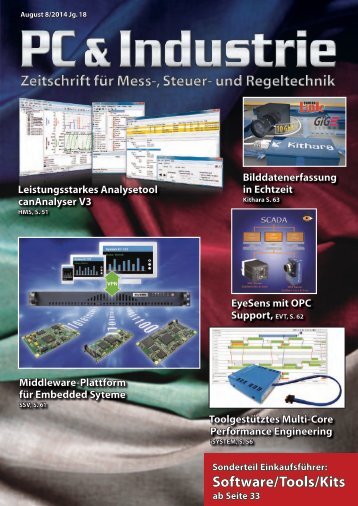

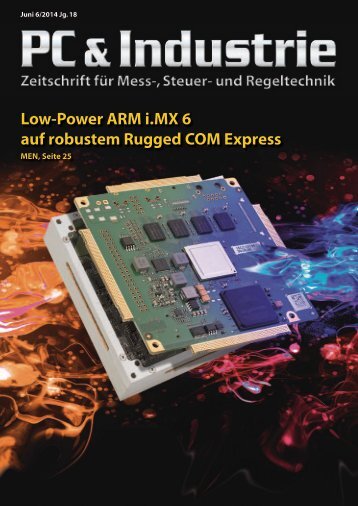

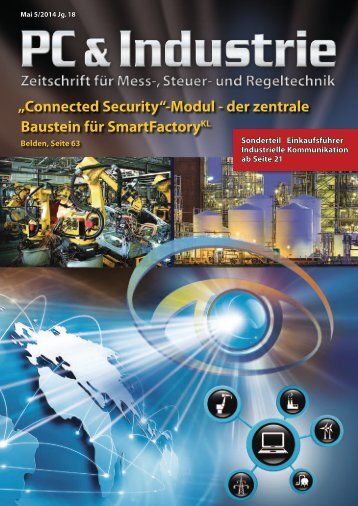

PC & Industrie

meditronic-journal

electronic fab

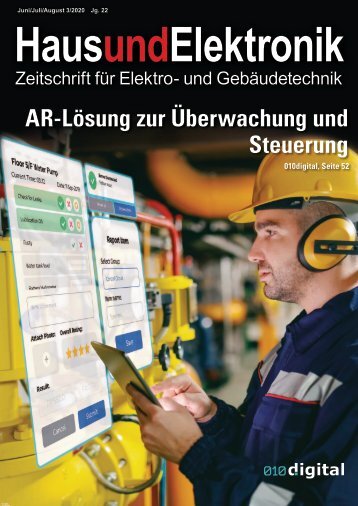

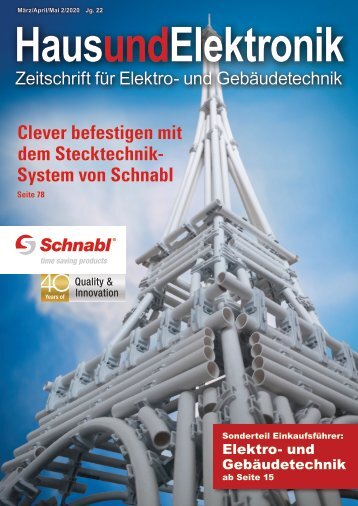

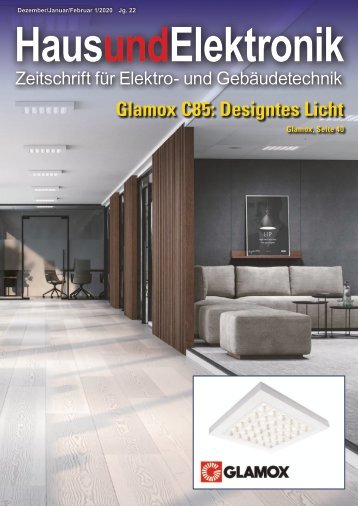

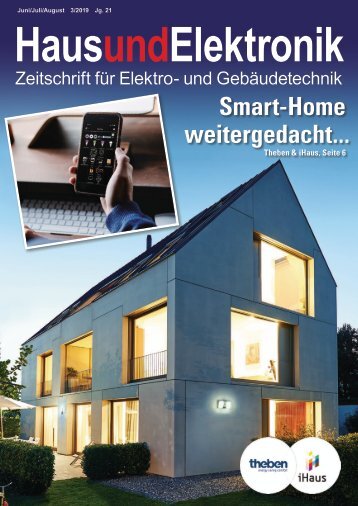

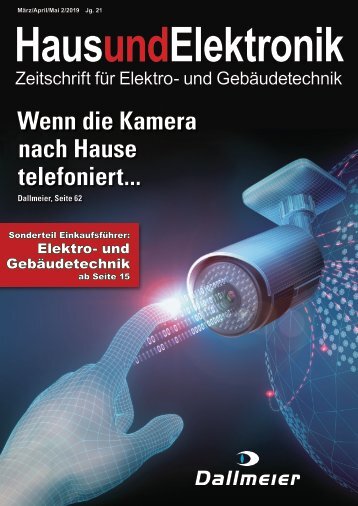

Haus und Elektronik

Mediadaten

© beam-Verlag Dipl.-Ing. Reinhard Birchel